El 24 de febrero de 2022, Rusia inició una “operación militar especial” en Ucrania, dando inicio a un enfrentamiento armado que parece estar lejos de terminar. Si bien se trata de un conflicto de larga data, su presencia en redes sociales ha aumentado desde dicha escalada. No solo circulan los reportes de las agencias de prensa al respecto, sino que otros usuarios de estas plataformas amplifican la información proveniente de la zona de guerra. Esta sobrecarga de información facilita la difusión de desinformación en el ecosistema digital.

En esa línea, los investigadores de Antibot4Navalny, grupo especializado en el análisis de operaciones de influencia en redes sociales, identificaron una estrategia de desinformación dirigida hacia los medios de comunicación y verificadores de datos.

Se trata de la “Operación Matrioska”, nombre derivado de las muñecas rusas que albergan en su interior una serie de muñecas más pequeñas. De acuerdo con los hallazgos del colectivo, esto ocurre desde, al menos, septiembre de 2023.

Pero, ¿en qué consiste esta estrategia?

Qué es la Operación Matrioska y cómo se vincula a la desinformación sobre la guerra en Ucrania

Fue en enero de 2024 que AFP Factuel (filial francesa de AFP Fact-Check), en colaboración con Antibot4Navalny, dio a conocer esta estrategia. A diferencia de las narrativas de desinformación que están dirigidas a los usuarios de las redes sociales, los perfiles que participan de la Operación Matrioska apuntan a los verificadores y medios de comunicación.

¿Cómo lo hacen? En X, mencionan los perfiles oficiales de estos medios y solicitan que se “verifique” el post que citan, el cual incluye contenido antiucraniano. De esa forma, tenemos a una cuenta A que solicita a uno o más medios que chequeen la información compartida por B en redes sociales. Al revisar el perfil de la cuenta B, se observa que, al igual que A, también consultó a diversos medios sobre la veracidad de un contenido publicado por una cuenta C.

Y así sucesivamente: cada cuenta que solicita un chequeo termina por publicar (dos o tres días después) una desinformación que otro perfil pide verificar.

Antibot4Navalny explica que, al realizar este ejercicio las veces necesarias, se llegará a la cuenta que difundió la primera desinformación y, por ende, la “muñeca” más pequeña de esta matrioska.

En febrero de este año, el colectivo publicó en su perfil de X algunos ejemplos de cómo operan las cuentas. En la siguiente imagen, se aprecia como el perfil “Gopinath” repite la misma consulta a tres cuentas de medios de fact-checking:

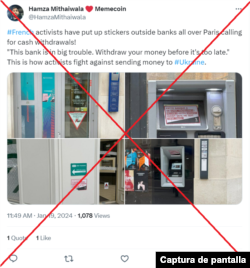

Realizamos el ejercicio de buscar en X la frase “check this” junto a la mención de medios de verificación como Newtral, Maldita.es, AFP Fact Check y EFE Verifica. Esto nos llevó al usuario “Faheem Ahmad”, el cual solicitó a más de 80 medios de comunicación (como DW News, Le Monde y BBC News) y de verificación (como Newtral, StopFake.org y VeSyria) chequear un post realizado por “Hamza Mithaiwala”.

Como se aprecia en la captura anterior, todas esas solicitudes se realizaron el día 19 de enero. La desinformación citada por “Faheem Ahmad” fue publicada el mismo día. Según un archivo del 1 de febrero, “Hamza Mithaiwala” publicó que activistas franceses llamaron a que sus connacionales realicen giros de dinero “antes de que sea demasiado tarde”. A junio de 2024, no existen registros de que se llevara a cabo esta forma de protesta.

Estos contenidos también son enviados a los verificadores vía correo electrónico

El 4 de junio, la empresa finlandesa de investigación digital “Check First” publicó un informe sobre lo que ellos llaman “Operación Sobrecarga” (“Operation Overload”, en inglés). En su reporte, indican que se basaron en los hallazgos de Antibot4Navalny y AFP en X para extender la investigación.

De esa forma, descubrieron que las organizaciones de verificación, y medios de comunicación, también reciben estas solicitudes vía correo electrónico.

Como ejemplo, Check First adjunta el siguiente correo electrónico (que hemos traducido al español). En él, se incluyen varios enlaces a canales de Telegram que han difundido el contenido.

El nombre que le dieron a esta operación deriva de esta “acumulación” de solicitudes para verificar información, lo cual crea la ilusión de que se trata de contenido viral y que, por lo tanto, es necesario desmentir para frenar su difusión.

Christine Dugoin-Clement, nalista geopolítica e investigadora especializada en estrategias de influencia, cibernética e inteligencia artificial, habló sobre la Operación Matrioska en el podcast (un)Safe Country del Centro de Estrategias de Defensa, el Centro de Medios de Ucrania y Ukrayinska Pravda. En el episodio del 24 de abril, señaló que quienes desinforman se benefician de esta situación sin importar si el contenido enviado es verificado o no:

“Si te niegas, pueden alimentar sus narrativas. 'Mira, esto es censura. Dicen que quieren verificar los hechos, pero no lo hacen cuando proporcionamos información'. Por otro lado, puedes decir: 'Está bien, voy a comprobar estas cosas'. Sin embargo, esto dispersa enormemente la atención de los verificadores de datos, por lo que los rusos se benefician en ambos casos”.

Cabe señalar que los contenidos difundidos siguen la estrategia conocida como “Operación Doppelganger”, la cual consiste en la imitación y “clonación” de medios reconocidos para difundir desinformación. De esa forma, y vinculado al conflicto en Ucrania, se busca instalar narrativas que perjudican la imagen del país, sus políticos o, incluso, los refugiados.

En este artículo abordamos algunos ejemplos:

[Este artículo es parte de la alianza periodística de verificación entre Mala Espina, de Chile, y Voz de América. Para saber más sobre la metodología utilizada en los chequeos, puedes ingresar a este enlace.]

¡Conéctate con la Voz de América! Suscríbete a nuestros canales de YouTube, WhatsApp y al newsletter. Activa las notificaciones y síguenos en Facebook, X e Instagram.

![Las tradicionales muñecas rusas Matrioska se exhiben a la venta en Moscú, Rusia, el lunes 29 de diciembre de 2014. [Foto: Archivo/AP]](https://gdb.voanews.com/886d38fe-e6a7-459a-b484-467ae2e4150f_w250_r1_s.jpg)

![Un oficial de la 10.ª Brigada de Asalto de Montaña y veterano de la guerra ruso-ucraniana presenta sus respetos en un monumento improvisado a los soldados ucranianos caídos en en Kiev, el 28 de mayo de 2024, en medio de la invasión rusa de Ucrania. [Foto: Archivo/AFP]](https://gdb.voanews.com/42e03390-e7ce-4793-a0ca-f1a1bf8f915c_w100_r1.jpg)

Foro