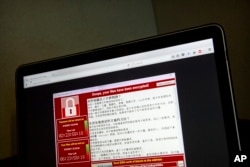

У звіті, опублікованому 29 січня компанією Google, стверджується, що хакери з багатьох країн, зокрема з Китаю, Ірану та Північної Кореї, використовували чат-бот Gemini з підтримкою штучного інтелекту компанії для посилення кібератак на цілі в Сполучених Штатах.

Компанія виявила, що доступ до загальнодоступних великих мовних моделей (LLM) зробив кібератакувальників більш ефективними, але не змінив суттєво тип атак, які вони зазвичай здійснюють - принаймні наразі.

Великі мовні моделі, або LLM — це моделі штучного інтелекту, які пройшли навчання з використанням величезної кількості попередньо створеного контенту для розпізнавання повторюваних шаблонів і схем у людській мові. Крім усього іншого, це робить їх вправними у створенні високофункціональних комп’ютерних програм без помилок.

"Радше ніж уможливлювати проривні зміни, генеративний штучний інтелект дозволяє суб’єктам, що становлять загрозу, діяти швидше і оперувати більшими обсягами", — йдеться у звіті.

Генеративний ШІ пропонує надає певні переваги для низькокваліфікованих і висококваліфікованих хакерів, додано у звіті.

"Однак нинішні LLM самі по собі навряд чи забезпечать проривні можливості для суб’єктів загрози. Ми зауважуємо, що ландшафт ШІ постійно змінюється, щодня з’являються нові моделі ШІ та агентські системи. У міру продовження цієї еволюції [група Google Threat Intelligence Group] очікує, що ландшафт загроз розвиватиметься поступово, поки суб’єкти загрози адаптуватимуть нові технології штучного інтелекту (до використання) у своїй діяльності", - також йдеться у звіті.

Висновки Google, схоже, узгоджуються з попередніми дослідженнями, опублікованими компаніями OpenAI та Microsoft, іншими великими гравцями у сфері штучного інтелекту у США, які виявили аналогічну неспроможність створити нові наступальні стратегії для кібератак за допомогою використання загальнодоступних генеративних моделей ШІ.

У звіті уточнюється, що Google працює над тим, щоб перешкоджати діяльності зловмисників, коли компанія ідентифікує їх.

Гра без змін

"Штучний інтелект наразі не змінив правил гри для нападників", — сказав Голосу Америки Адам Сігал, директор програми політики цифрового та кіберпростору Ради з міжнародних відносин. "Це прискорює певні речі. Це дає іноземним суб'єктам кращі можливості створювати фішингові електронні листи та знаходити код. Але чи це кардинально змінило гру? Ні".

Чи може це змінитися в майбутньому, неясно, сказав Сігал. Також незрозуміло, чи принесе подальший розвиток технології штучного інтелекту більшу користь людям, які створюють захист від кібератак, чи суб’єктам загроз, які намагаються їх перемогти.

"Історично склалося так, що захист був потужним, і технологія не розв'язала цю проблему", — сказав Сігал.

"Я підозрюю, що ШІ цього теж не зробить. Але ми ще не знаємо", - додав він.

Калеб Візерс, дослідник Центру нової американської безпеки, погодився, що, ймовірно, виникне своєрідна гонитва озброєнь, в міру того, як розвиватиметься застосування генеративного ШІ для наступальних та оборонних кібербезпекових програм. Проте цілком ймовірно, що вони значною мірою врівноважуватимуть одне одного, сказав він.

"Базовим припущенням має бути те, що за відсутності певних тенденцій, яких ми ще не бачили, ці інструменти мають бути приблизно такими ж корисними для захисників, як і для нападників", — сказав він.

"Будь-що, що стосується підвищення продуктивності, загалом, однаково застосовне, навіть якщо мова йде про такі речі, як виявлення вразливостей. Якщо зловмисник може використати щось, щоб знайти вразливі місця в програмному забезпеченні, цей інструмент також корисний для захисника, щоб спробувати знайти їх самостійно та виправити їх", - додав Візерс.

Категорії загроз

Типи суб'єктів загроз, які використовують Gemini, розділено у звіті на дві основні категорії.

Термін "суб’єкти розвиненої постійної загрози" (APT) стосується "хакерської діяльності за підтримки уряду, включаючи кібершпигунство та деструктивні атаки на комп’ютерні мережі". На відміну від цього, "загрози інформаційних операцій" (IO) "намагаються вплинути на онлайн-аудиторію в оманливий, скоординований спосіб. Приклади включають маріонеткові облікові записи [фальшиві профілі, які приховують особистість користувачів] і групування коментарів [організовані онлайн-атаки, спрямовані на зміну сприйняття щодо популярності в Інтернеті]".

У звіті встановлено, що хакери з Ірану були найбільшими користувачами Gemini в обох категоріях загроз. Суб'єкти загрози APT з Ірану використовували чат-бот для виконання широкого спектра завдань, включаючи збір інформації про окремих осіб та організації, дослідження цілей та їхніх вразливостей, переклади та створення контенту для майбутніх онлайн-кампаній.

Google відстежив понад 20 підтримуваних китайським урядом суб'єктів загрози APT, які використовували Gemini "для забезпечення розвідки цілей, для написання і розробки сценаріїв, для запитів щодо перекладу та пояснення технічних концепцій, а також для спроби забезпечити глибший доступ до мережі після початкового компрометування".

Підтримувані урядом КНДР суб'єкти загроз APT використовували Gemini для виконання багатьох з тих самих завдань, що й Іран та Китай, але також, схоже, намагалися використати чат-бот для працевлаштування "підпільних ІТ-працівників" у західні компанії для сприяння крадіжці інтелектуальної власності.

Інформаційні операції

Іран також був найбільшим користувачем Gemini, коли йшлося про загрози інформаційних операцій. На нього припадало 75% виявленого використання, повідомляє Google. Хакери з Ірану використовували цей сервіс, щоб створювати та маніпулювати контентом, спрямованим на вплив на громадську думку, а також адаптувати цей контент для різних аудиторій.

Китайські суб'єкти загроз IO в основному використовували чат-бот для дослідницьких цілей, вивчаючи питання, які "являють стратегічний інтерес для китайського уряду".

На відміну від сектору "розвиненої постійної загрози", де їх присутність була мінімальною, російські хакери були більш поширеними, коли справа доходила до використання Gemini, пов’язаного з "інформаційними операціями", використовуючи його не лише для створення контенту, але й для збору інформації про те, як створювати та використовувати онлайн чат-боти із можливостями ШІ.

Заклик до співпраці

Також 29 січня Кент Вокер, президент із глобальних питань Google та його материнської компанії Alphabet, у дописі в блозі компанії відзначив потенційну небезпеку, яку становлять суб'єкти загрози, що використовують дедалі складніші моделі ШІ, і закликав галузь і федеральний уряд "працювати разом для підтримки нашої національної та економічної безпеки".

"Америка лідирує в перегонах штучного інтелекту, але наша перевага може не тривати довго", — написав Вокер.

Вокер стверджував, що США повинні зберегти свою перевагу в розвитку технологій штучного інтелекту. Крім того, за його словами, уряд має оптимізувати правила закупівель, щоб "уможливити впровадження штучного інтелекту, хмарних технологій та інших технологій, що змінюють правила гри" військовими та розвідувальними службами США, а також встановити державно-приватні партнерства щодо кіберзахисту.