La inteligencia artificial (IA) ha experimentado un impresionante avance en las últimas décadas, y mediante herramientas como ChatGPT de OpenAI, científicos e ingenieros nos están dando una fascinante visión de lo que nos depara el futuro.

“Lo que tenemos actualmente en ChatGPT, son las migajas de lo que ahorita ellos ya tienen disponible”, dijo Jorge Pérez, co-fundador de Latinos On Chain.

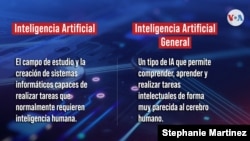

“En la última década hubo ya muchas aplicaciones y adopción a nivel empresarial a nivel de organizaciones, desde una perspectiva de desarrollar modelos de aprendizaje supervisado. Eso es lo que básicamente quiere decir es que a partir de datos históricos, el puede aprender patrones que se entrenan en un algoritmo que te permite predecir cosas a futuro”, explicó Belén Sánchez Hidalgo, científica de datos de DataRobot, una plataforma de IA que permite a las empresas crear modelos predictivos para acelerar su crecimiento.

Hoy, la tecnología artificial ya es capaz de aprender de forma autónoma. El software AlphaGo Zero, por ejemplo, alcanzó un nivel de rendimiento sobrehumano después de solo tres días de jugar contra sí mismo.

“Perdía pero cada vez aprendía y perdía menos. Hasta que llegó a un punto donde pusieron la inteligencia artificial contra un master de los mejores del mundo humano en ese juego él AI le ganó”, agregó Giovanni Rodríguez, co-fundador de Latinos On Chain.

¿Podría la inteligencia artificial alcanzar la autonomía absoluta?

Lo que muchos se preguntan es si el próximo avance de la inteligencia artificial será la autonomía de procesos cognitivos, como tomar decisiones y actuar sin necesidad de la intervención humana.

“Lo que vemos en las películas como Terminator, todas esas películas donde de repente la tecnología se pone en contra del ser humano es cuando la tecnología ya no requiere que le pongas un ‘input’. Por sí mismo puede comenzar a procesar información, a crear una conciencia misma”, anotó Pérez.

Mientras tanto, Sánchez Hidalgo considera que aun falta mucho por recorrer.

“Todavía creo que no estamos ahí. Creo que todavía estamos muy lejos. Obviamente algo que sí pasa es que la robótica y la inteligencia artificial empiezan a interactuar cada vez más y más cerca. Yo creo que hay que ser muy, muy cautelosos al momento que estamos hablando de estas nuevas tecnologías y de no humanizarlas”, dijo Sánchez Hidalgo.

Según la experta, estas tecnologías aprenden de información histórica y tienen la capacidad de crear narrativas.

“Desde que les empiezas a preguntar cosas como me vas a destruir, probablemente ya han visto textos en el Internet que hablan sobre teorías de que la inteligencia artificial va a destruir la humanidad y puede empezar en ese proceso generativo, creativo, a sacar esa narrativa también contigo”, explicó la científica.

Mientras que algunos dudan de que estemos cerca de ese punto, otros destacan que hay expertos desarrollando parámetros y descifrando mejores formas para programar la inteligencia artificial para evitar cualquier riesgo.

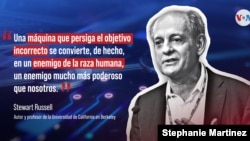

En entrevista con el programa Today de la BBC, Stuart Russell, autor y profesor de la Universidad de California en Berkeley dijo que "una máquina que persiga el objetivo incorrecto se convierte, de hecho, en un enemigo de la raza humana, un enemigo mucho más poderoso que nosotros".

En su libro "Compatible con humanos: inteligencia artificial y el problema del control", Russell explica que el riesgo no radica en la autonomía, sino en la extraordinaria competencia que las máquinas pueden alcanzar.

“Supongamos que tenemos un poderoso sistema de IA que es capaz de controlar el clima del planeta y que queremos usarlo para devolver los niveles de CO2 en nuestra atmósfera a la época preindustrial. El sistema descubre que la forma más fácil de hacerlo es deshacerse de todos los seres humanos, porque ellos son los que están produciendo todo este dióxido de carbono en primer lugar. Podrías decir ‘bueno, puedes hacer lo que quieras pero no puedes deshacerte de los seres humanos’. Entonces, ¿qué hace? Simplemente nos convence de tener menos hijos hasta que no queden seres humanos”, explicó Russell.

¿Y la solución que propone? Diseñar máquinas que desconozcan el objetivo y que sean inherentemente inseguras sobre las preferencias humanas.

"Una vez los sistemas funcionen de esa manera, se rinden ante los seres humanos de una forma casi mágica. Empezarán a pedir permiso antes de hacer cosas porque no están seguros de lo que quieres", agregó Russell.

No obstante, Sánchez Hidalgo dice que uno de los problemas más urgentes es la falta de diversidad en la industria, no solo por motivos de representatividad, sino por la necesidad de contar con una variedad de perspectivas que nos permitan desarrollar tecnologías no sesgadas.

“Creo que el gran reto está en cómo democratizar el acceso al conocimiento de estas tecnologías para que la conversación sea mucho más amplia, más diversa y por ende, ojalá más responsable”, aseguró Sánchez Hidalgo.

¡Conéctate con la Voz de América! Suscríbete a nuestro canal de YouTube y activa las notificaciones, o bien, síguenos en las redes sociales: Facebook, Twitter e Instagram.